伍云霞,孟祥龙

(中国矿业大学(北京) 机电与信息工程学院,北京 100083)

摘 要:针对训练样本不足情况下的煤岩图像识别问题,提出了一种局部约束的自学习(LCSL)煤岩识别方法。该方法首先从辅助数据中通过局部约束的字典优化模型获取高层结构特征,这些辅助数据是无标签的非煤岩自然图像,与煤岩图像的特征分布不同,且更容易获取;然后利用学习的高层结构特征结合局部约束线性编码提取煤岩图像特征;最后利用SVM算法对煤岩图像进行分类识别。实验表明:通过该方法得到的特征能够有效地表征煤岩图像,具有很强的鉴别性和鲁棒性,达到了很好地识别效果,相比于原有煤岩识别方法平均识别率提高了1%~3%。

关键词:煤岩识别;特征表达;自学习;局部约束

中图分类号:TD67;TP391.41

文献标志码:A

文章编号:0253-9993(2018)09-2639-08

移动阅读

伍云霞,孟祥龙.局部约束的自学习煤岩识别方法[J].煤炭学报,2018,43(9):2639-2646.doi:10.13225/j.cnki.jccs.2018.0385

WU Yunxia,MENG Xianglong.Locality-constrained self-taught learning for coal-rock recognition[J].Journal of China Coal Society,2018,43(9):2639-2646.doi:10.13225/j.cnki.jccs.2018.0385

收稿日期:2018-03-26

修回日期:2018-08-15

责任编辑:许书阁

基金项目:国家重点研发计划资助项目(2017YFC0804302)

作者简介:伍云霞(1967—),女,湖北天门人,教授,博士。E-mail:angil.wu@163.com

WU Yunxia,MENG Xianglong

(School of Mechanical Electronic & Information Engineering,China University of Mining & Technology (Beijing),Beijing 100083,China)

Abstract:In terms of the coal-rock image recognition problems in case of insufficient training samples,a new method of locality-constrained self-taught learning for coal-rock recognition was proposed.This method first obtains the dictionary matrix from the unlabeled random images.These training samples are unlabeled non-coal-rock images from a common data set,which are different from coal-rock images.Then the method uses the local linear constraint coding method to get spare coding of coal-rock image samples,which are used as a feature of coal-rock image.Finally,the SVM classification algorithm is adopted to identify coal-rock images.Experiments show that the image high-level visual structures can be obtained from a large number of unlabeled random image samples through self-taught learning local constraint linear coding method,and the image features can be expressed concisely and effectively with these structures.This algorithm has a wide range of applicability.Compared with the original coding algorithm,the proposed method is more efficient,and the average coal-rock image recognition accuracy increases by 1%-3%.

Key words:coal-rock recognition;feature expression;self-taught learning;locality-constrained

煤岩识别技术在煤炭开采领域应用前景广泛[1],传统的煤岩识别技术,例如γ射线、红外、声音、雷达等技术易受地质条件和采煤工艺的影响,难以在实际应用中推广[2-5]。因此,基于机器视觉的煤岩识别技术开始受到研究者的关注。

在基于机器视觉的煤岩识别技术中煤岩图像的特征提取是关键,目前特征提取的方式大致分为两类,一类是基于数学模型的特征提取,文献[6]提出了基于小波变换的煤岩识别方法,利用给定的小波基提取煤岩图像特征;文献[7]基于小波域非对称广义高斯模型,利用已有的小波域非对称广义高斯模型刻画煤岩图像的纹理特征,这类方法得到的特征有时不能准确地表达煤岩图像。另一类是通过学习的方式从样本中得到特征;文献[8]提出了基于字典学习的煤岩图像特征提取与识别方法,利用字典学习的方法从煤岩图像样本获取特征,这类方法能够充分提炼煤岩图像中的特征,得到的特征能够更准确地表达煤岩图像,但这种高质量表达需要训练过程中有足量的样本,若训练样本数量太少,一方面不能真实地反映出煤岩图像的特征分布,使得训练得到的煤岩特征表达能力弱,不能达到理想的识别效果;另一方面训练样本太少,识别模型的训练容易过拟合致使泛化性能低。在煤矿开采中,不论是长壁开采还是放顶煤开采,众所周知,开采环境工况恶劣,安全生产要求严格,大量取样样本图像代价高昂,因而从少量样本中获得鉴别性强的煤岩图像特征以利于煤岩的正确识别是需要解决的问题。在机器学习领域,为解决标签样本缺乏的问题,研究人员提出了不同的机器学习理论,如半监督学习[9]、迁移学习[10]和自学习[11],在半监督学习中,当现有的带标签训练样本数量不足时,需要在有标签的训练样本数据集的基础上,加入大量同类的无标签样本图像辅助训练,节省了标记样本的开销,但不能解决煤炭开采中工作面图像难以获取的问题;迁移学习中,当待分类任务(目标域)中的带标签训练样本不足时,利用大量相关的其他类训练数据作为训练集,这些数据称为源域,但为了防止出现“负迁移”的情况,要求源域样本与目标域存在一定的共有特征[12-14],如为识别老虎和斑马,辅助图像可以是马、熊等。源域和目标域具有相关性的这一要求在实际操作中存在一定的困难[11-12]。

近年来的研究发现大部分自然图像中都包含有相似的视觉形态(如边、角等结构特征),这些基本的视觉形态是组成图像的基本结构,基于这一原理,自学习理论开始被关注[11,15-17],自学习算法是迁移学习的一种改进,它的不同之处在于放宽了对源域样本的限制,源域样本无标签,并且可以与目标域样本具有不同的特征分布,这使得自学习理论的应用十分广泛,RAINA等[11]提出了一种基于自学习的图像分类方法,它利用稀疏编码的方式从源域中获取高层结构特征,然后用这些高层结构特征来编码目标域图像样本,实现图像识别,提高了识别率,但由于采用的是L1范数约束的稀疏编码方式提取图像样本特征,存在编码运算量大,编码不稳定等问题;文献[15]提出了一种基于自学习的联合聚类方法,同时对目标数据和无标签不相关辅助数据集进行特征聚类,并共享特征簇,从而提高聚类效果;文献[16]提出了一种基于自学习低秩编码的学习框架,在编码过程中引入低秩约束从而更好地表达目标集的结构。

笔者针对煤岩识别技术中存在的大样本获取困难的问题,基于自学习理论,提出了一种局部约束的自学习煤岩识别方法,假定辅助数据集中的样本无标签,且与煤岩样本特征分布不同,采用了局部约束的字典优化模型,获取的特征字典矩阵中保留有图像的局部结构信息,并且由于编码过程存在解析解,相比于L1范数约束的编码方式效率更高且编码稳定。

笔者提出的局部约束的自学习煤岩识别方法由3步组成:首先通过局部约束的字典优化模型从辅助数据集中获取组成图像的高层结构特征(如图像的边,角等)构成字典矩阵D,然后利用已经训练好的字典D通过局部约束线性编码的方式提取煤岩图像特征,最后利用得到的煤岩特征训练SVM分类器,并对未知煤岩图像提取特征后进行识别输出类别(煤或岩)。算法的总体框架如图1所示。

图1 局部约束的自学习煤岩识别方法的总体框架

Fig.1 Framework of the Locality-constrained self-taught learning for coal-rock image recognition method

组成图像的高层结构特征可以通过字典学习的方法从辅助数据集中获取,学习得到的字典矩阵中的每个原子表示图像的一种高层结构特征,字典学习是通过优化代价函数得到字典矩阵的过程,它的优化模型可以描述[12]为

βgA(Α)}

(1)

式中,X∈Rn×M为训练样本集;D∈Rn×K字典矩阵;A∈Rk×M为训练样本对应的稀疏向量矩阵;β为正则化参数,在重构误差与稀疏度间起平衡作用;gA(·)为模型中稀疏系数的约束条件,常见的稀疏约束条件有L0范数‖·‖0和L1范数‖·‖1约束,但在这种约束条件下,由于字典的过完备性,相似的样本在迭代优化中可能选择了完全不同的字典原子,丢失了字典原子之间的相关性,并且稀疏编码过程没有解析解,优化效率低。

文献[18]从理论上认为编码的局部性一定会产生稀疏性,但稀疏性却不一定会产生局部性,这就说明了编码的局部性要优于稀疏性。基于这一原理,结合上述字典学习模型,本文采用局部约束的字典优化模型[19]求取字典矩阵,给定由未标记随机自然图像组成的训练样本集![]() ,…,

,…,![]() ,…,

,…,![]() ,其中

,其中![]() ∈Rn,优化函数为

∈Rn,优化函数为

β![]()

s.t. 1Ta(i)=1,∀i

(2)

其中,‖·‖2为L2范数;![]() 为稀疏编码的局部约束项;β为正则化参数;1为全1向量。式中需要优化的变量为字典矩阵D={d1…,dj…,dK},其中dj∈Rn,dj为字典的原子即某一列向量,每个原子是n维向量;稀疏向量矩阵A={a(1),a(2),…,a(i),…,a(M)},其中a(i)∈RK,每个稀疏向量维度为K;pi=[pi1…,pij…,piK],其中

为稀疏编码的局部约束项;β为正则化参数;1为全1向量。式中需要优化的变量为字典矩阵D={d1…,dj…,dK},其中dj∈Rn,dj为字典的原子即某一列向量,每个原子是n维向量;稀疏向量矩阵A={a(1),a(2),…,a(i),…,a(M)},其中a(i)∈RK,每个稀疏向量维度为K;pi=[pi1…,pij…,piK],其中

pij=‖xi-dj‖2

(3)

其中,xi表示任意给定的训练样本矩阵X的第i个图像样本向量;pij表示向量xi与字典中第j个原子之间的欧氏距离,用来衡量该样本向量编码的权重值;⊙表示向量对应元素相乘的运算。通过上述的局部约束项,与样本相关性越小的特征原子(即欧氏距离越大)在优化过程中对应的重构系数就会越小,甚至为0,这样在编码的过程中只是用到了与样本向量近邻的原子,实现了编码的局部性,也使编码结果具有很高的平滑度。

式(2)是一个凸优化问题,优化过程中分为字典更新和稀疏编码2个步骤。

在字典更新过程中,固定稀疏编码,优化函数为

β![]()

(4)

定义式(4)为一个关于D的函数F(D),其变量为dj,其中j∈{1,2,…,K},给出其对每一个字典原子的偏导数如式(5)所示。

β[a(ij)]2×

![]()

(5)

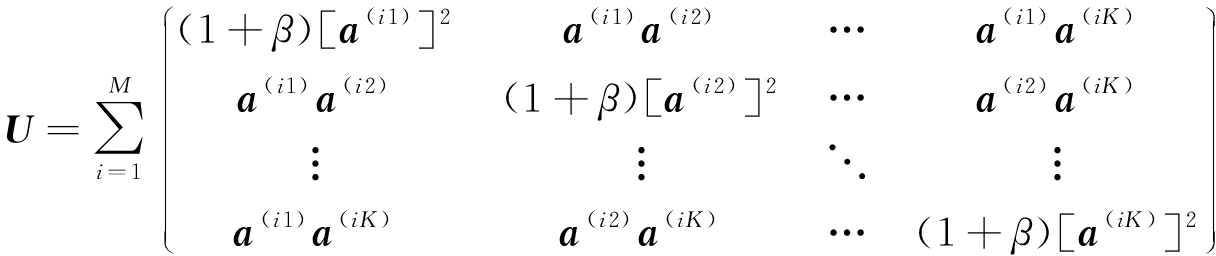

由于式(4)是一个无约束的凸优化问题,令式(5)为0即可求解得到D的优化值。即UDT=V,其中U∈RK×K,V∈RK×n,即

在稀疏编码过程中,字典D固定,优化函数变为

β![]()

s.t. 1Ta(i)=1,∀i

(6)

上述优化问题可用拉格朗日乘子法求解,构建拉格朗日方程L(a(i),η)如式(7)所示。

L(a(i),η![]() β

β![]()

η[1Ta(i)-1]

(7)

通过求解拉格朗日方程得到样本的稀疏编码a(i):

∂i+βdiag2(pi)]-1\1

(8)

![]() /

/![]()

(9)

![]()

(10)

由于上述两个步骤均存在解析解,因此训练效率更高,这一过程通过离线训练完成。最终得到包含图像高层结构特征的字典矩阵D。

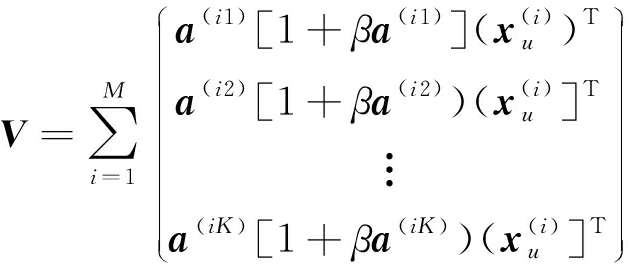

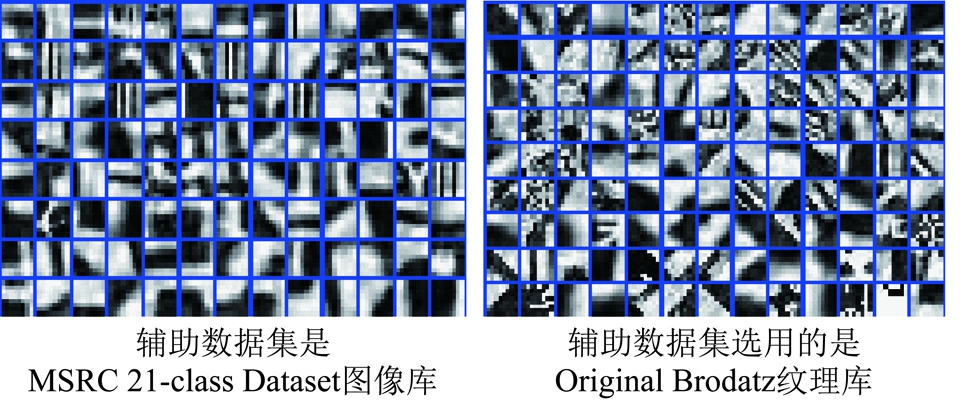

可视化所得字典如图3所示,图中给出了两类辅助数据集下获取的图像结构特征,一个是MSRC 21-class Dataset图像库,另外一个是Original Brodatz纹理库。部分样本如图2所示。

图3中每个字典矩阵中的每个方块大小为8×8,表示字典矩阵的一个原子即一种图像的视觉结构特征(包括图像的边、角等)。

为了更直观的表现两个字典的相似性,求取两个字典原子两两之间的差值向量的L2范数,并设置不同的阈值进行统计分析,若两个原子差向量的L2范数小于设定阈值视为相同原子。

图2 两类辅助数据集样本图像

Fig.2 Two different training sample images

图3 从两种辅助数据集中获取的部分结构特征

Fig.3 Partial visual structure features obtained from two different training samples

设两个字典分别为D1-MSRC,D2-Brodatz∈R64×k,定义如下函数:

f(x)=∑i∑j‖d1i-d2j‖2(i,j=1,2,…,k)

(11)

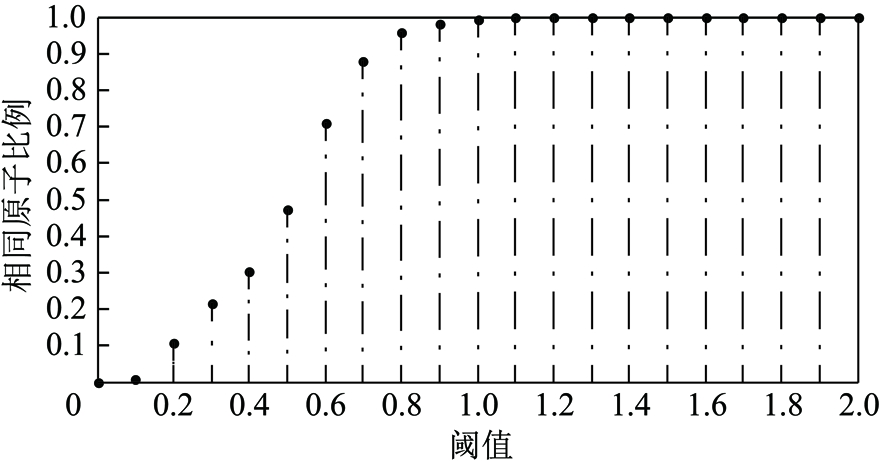

设置不同的阈值Tc,则有如下函数:

(12)

其中,Tc∈[0,2],步长为0.1,由T(x)可以得出在不同的阈值下,两个字典矩阵相似的原子个数,通过计算所占比例,得出不同阈值下的相似性的概率统计,结果如图4所示。

图4 不同阈值下两个字典的相似对比情况

Fig.4 Comparison of two dictionary under different thresholds

由图4的统计结果可知,两个字典中相对误差在35%以内的原子占到了字典原子总数的90%,由此可见,从完全不同的辅助数据集中得到的两个字典,其中绝大部分原子是相似的,说明了大部分自然图像中都包含有相似的结构特征。

给定带标签的煤岩图像样本集![]() ,…,

,…,![]() ,…,

,…,![]() 和上节得到的字典矩阵D,通过式(9)即可得到表征煤岩图像的稀疏特征向量,实现了对煤岩图像的特征提取,这种特征更加简洁,鉴别性更高。

和上节得到的字典矩阵D,通过式(9)即可得到表征煤岩图像的稀疏特征向量,实现了对煤岩图像的特征提取,这种特征更加简洁,鉴别性更高。

本文采用SVM分类器,在SVM分类器中核函数的种类主要有线性核函数、多项式核函数、高斯核函数(RBF径向基核函数),本文选用分类性能较好的高斯核函数,表达式如下:

k(x1,![]()

(13)

式中,x1,x2为任意两个煤岩图像的稀疏特征向量;σ为尺度参数,用于控制核函数的径向作用范围。

算法1说明了提出的局部约束的自学习煤岩识别方法。

算法1:局部约束的自学习煤岩识别方法。

输入:带有标记的煤岩图像样本Z个,

![]() ,y(1)),

,y(1)),![]() ,y(2)),…,

,y(2)),…,![]() ,y(Z))}

,y(Z))}

未标记的辅助数据样本M个

,![]() ,…,

,…,![]()

输出:分类器。

(1)使用未标记的辅助数据集![]() 求解式(2)所示的局部约束字典优化问题,并得到字典矩阵D,字典矩阵的原子dj即为图像的高层结构特征;

求解式(2)所示的局部约束字典优化问题,并得到字典矩阵D,字典矩阵的原子dj即为图像的高层结构特征;

(2)通过局部约束线性编码的方式,用字典原子的线性组合表示煤岩图像样本,这些线性组合的系数组成一个新的稀疏向量,作为新的特征表征煤岩图像,求解式(6)得到样本的稀疏向量![]() ,由此得到一个新的带标记的煤岩图像样本集

,由此得到一个新的带标记的煤岩图像样本集

![]() ,

,![]()

(3)用新的带标记煤岩图像样本集训练分类器(本文采用SVM分类器)。

返回:分类器。

本文实验数据在Matlab R2013b实验平台上运行。

本文用从两个辅助数据集中得到的字典进行了对比实验,两个字典分别分别记为D1-MSRC和D2-Brodatz。

辅助数据集分别为:MSRC 21-class Dataset图像库共21类591幅图像,大小为320×213像素,实验中选取10类,每类20幅共200张组成辅助数据集1;Original Brodatz纹理库共112张图像,大小为640×640像素,实验中选取112张组成辅助数据集2。

上述两个辅助数据集大小统一调整为100×100像素,然后对两个数据集中每幅图像进行灰度化处理并将灰度矩阵变换为列向量,按列组成样本向量矩阵,经PCA降维至64维。部分灰度化的样本图像见1.1节中的图2。

煤岩分类实验所用的煤岩图像样本包含有不同光照,不同视点下的烟煤、无烟煤、砂岩、页岩的灰度图像各50幅组成共200幅的样本集,图像大小为60×60,灰度级为256。从每类中随机选取25张组成训练集,剩余100幅图像作为测试集。图5给出了其中部分煤岩图像样本。实验中每张煤岩灰度矩阵变换为列向量并按列组成煤岩样本矩阵,采用PCA算法降维至64维。

图5 部分标记的煤岩图像样本

Fig.5 Partially labeled coal-rock image samples

为了准确地评价算法的效果,本文采用分类正确率(accuracy)和F1分数(F1 scores)参数[20]两项指标来评价最终的煤岩识别结果。

分类正确率是评价分类效果的常用指标;F1分数综合了分类器的回归率(Recall)和准确率(Precision),取值范围在0~1,取值越大代表分类效果越好,对于二分类定义宏平均F1分数(Macro-average F1 score),是所有类F1分数的算术平均,下面由公式给出定义:

×100%

(14)

![]() ×100%

×100%

(15)

![]() ×100%

×100%

(16)

![]() ×100%

×100%

(17)

![]() ×100%

×100%

(18)

其中,c代表类别数;TP,FP,TN,FN分别代表真正例、假正例、真反例、假反例的个数。

采用SVM分类器对煤岩图像进行分类。训练SVM分类器时,设定尺度参数σ的取值范围为[2-15,22],惩罚因子ζ的取值范围为[2-3,220],采用5折交叉验证网格搜索的方法从中寻找最优的参数组合,得到最优的分类模型。

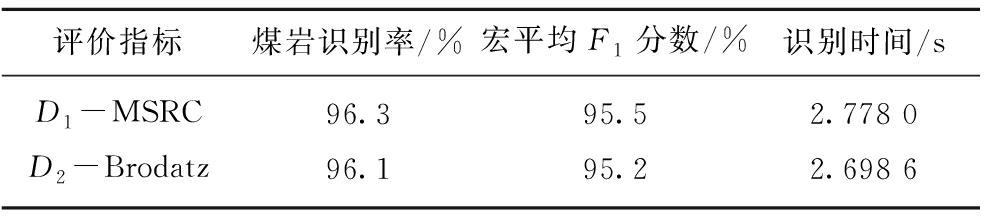

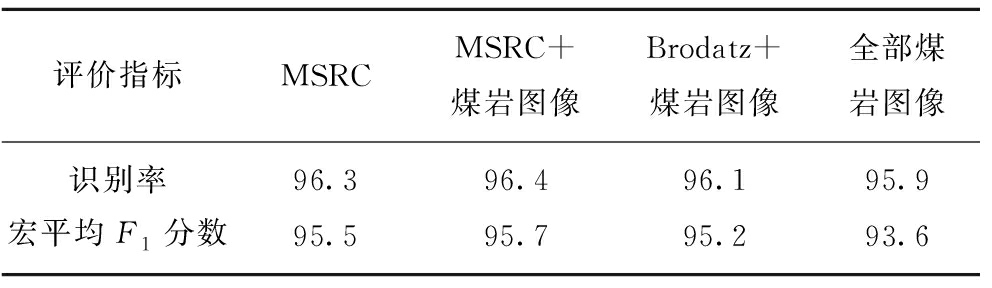

在正则化参数β=0.001,字典原子数为134,稀疏度为7的情况下,采用两种辅助数据集得到的实验结果见表1。

由表1的实验结果中可知,虽然采用不同的辅助数据集,但在其他参数一致的情况下,最终的识别率和宏平均F1分数相近,验证了两个字典中包含的高层结构特征是相似性,证明了局部约束的自学习煤岩识别方法的可行性。

表1 不同辅助数据集下的实验结果

Table 1 Results of the classification of different training samples

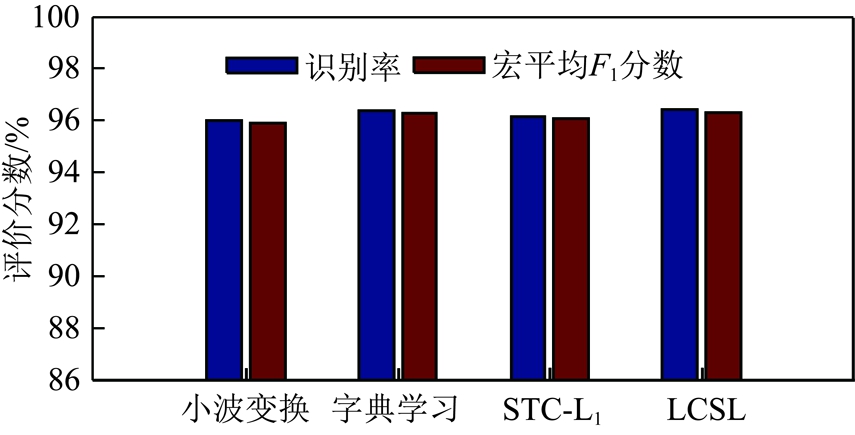

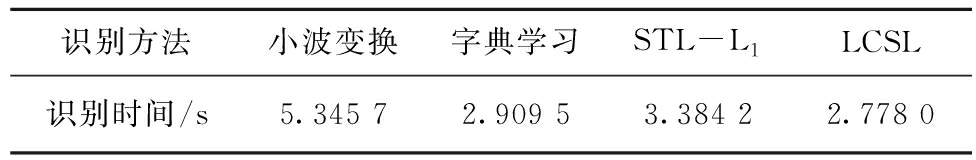

为了更准确的评估本文方法的可行性,采用基于小波变换[6]的煤岩识别方法、基于字典学习的煤岩识别方法[8]、基于L1范数约束的稀疏编码方式的自学习算法[11](STL-L1)与本文局部约束的自学习煤岩识别方法(LCSL)作对比试验,实验中采用MSRC 21-class Dataset辅助数据集,运行环境相同,字典原子数为134,稀疏度为7,β=0.001,得到的对比结果如图6所示。

图6 不同煤岩识别方法对比

Fig.6 Comparison of different coal-rock recognition methods

结合图6和表2可知,本文提出的自学习煤岩识别方法具有很好的识别效果,识别效果较原有方法都有提高,从识别时间上来看,因为本文方法采用了编码效率更高的局部约束稀疏编码,识别时间更快,满足实际应用的要求。

表2 不同算法识别时间对比

Table 2 Comparison of recognition time under different algorithms

本方法中包含的参数有正则化参数,辅助数据集,字典矩阵的原子数和稀疏向量的稀疏度(即稀疏向量中非零原子的个数),本节讨论这些参数对识别性能的影响。

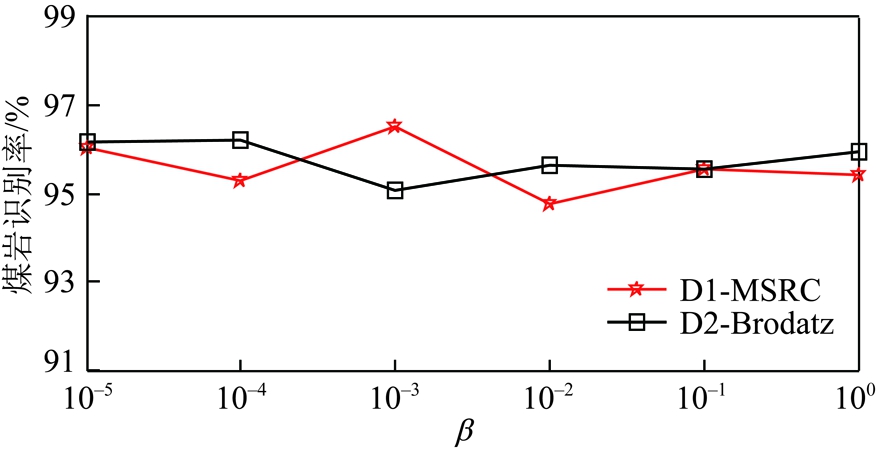

3.2.1 正则化参数对实验结果的影响

正则化参数β是局部约束项![]() 的参数,用于平衡重构误差与稀疏度的参数,一般认为正则化参数在[0.000 001,0.1]范围之内时能够取得好的识别效果[17],本文设定β的变化范围为[10-5,1],测试最终煤岩识别率的变化情况如图7所示。

的参数,用于平衡重构误差与稀疏度的参数,一般认为正则化参数在[0.000 001,0.1]范围之内时能够取得好的识别效果[17],本文设定β的变化范围为[10-5,1],测试最终煤岩识别率的变化情况如图7所示。

图7 不同辅助数据集下煤岩识别率随正则化参数的变化情况

Fig.7 Variation of Recognition Rate with Regularization Parameters under different training samples

由图7可知,煤岩识别率随不同的正则化参数β会产生波动,总体识别率在96%附近波动,但波动幅度很小,说明正则化参数的选取对煤岩识别率影响很小,本文实验中选取β=0.001。

3.2.2 辅助数据集对实验结果的影响

字典学习中辅助数据集直接关系到字典矩阵中高层特征的种类,采用4种不同类型的辅助数据集进行字典训练,分别为MSRC 21-class Dataset图像库组成的Ⅰ类辅助数据集;在MSRC 21-class Dataset数据集中加入少量无标签煤岩图像的Ⅱ类辅助数据集;在Original Brodatz数据集中加入少量无标签煤岩图像的Ⅲ类辅助数据集;全部无标签的煤岩图像组成的Ⅳ类辅助数据集。在字典原子数为134,稀疏度7的情况下,得到表3所示的识别结果。

表3 不同辅助数据集下的分类结果

Table 3 Results of the classification of different training samples%

通过表3可知在非煤岩辅助数据集中加入少量煤岩图像的识别效果要更好一些,但这3类最后的识别率相差很小,表明了非煤岩辅助数据集中包含的高层结构特征能够有效地表达煤岩图像,证明了局部约束的自学习煤岩识别方法的可行性。

3.2.3 字典原子数对实验结果的影响

字典的原子数表示字典矩阵中高层结构特征的数量,也直接关系到能否很好地提取煤岩图像的特征,从而影响最终的识别率。实验中,设置稀疏向量的稀疏度L为3,5,7,9几个值,测试在不同原子数下的煤岩识别率,实验结果如图8所示。

图8 不同字典原子数对应的煤岩识别率

Fig.8 Average recognition rate under different dictionary atoms

由图8可知,当固定稀疏向量的稀疏度时,字典原子数在134左右即约两倍于信号向量维度时,煤岩识别率取得最高值,低于134时,识别率随原子数的增加而增加,高于134时,原子数即使再增加,平均识别率变化不大,略有下降。这是由于当字典原子数过少时即字典原子数略大于信号向量维度,字典中没有包含足够的图像结构特征,导致优化过程中重构误差变大,使煤岩图像样本不能有效地表达,而当字典原子数再增加,字典中包含的冗余特征可以表征出煤岩图像的高层结构特征,在优化过程中就可以选出重构误差更小的字典原子组合,从而达到更好的识别效果。当字典原子数进一步增加,由于采用的是非煤岩图像作为训练样本,得到的字典中包含有与煤岩图像结构关联不大的特征,当原子数目过大时,在保证稀疏度一定的情况下,稀疏特征向量不能有效表达煤岩图像导致识别率下降。

另一方面,在同一字典下,稀疏向量的稀疏度也会对识别结果产生很大的影响。由图8可知,当稀疏度为7时,煤岩识别率达到最高值,当稀疏度过小或过大时,特征向量不能准确地表达煤岩图像,识别率会略有下降。

从工作面采集的测试图像,往往会受到粉尘污染,采用高斯噪声模拟粉尘污染对提出方法的性能进行了测试。实验中在待测样本中加入不同信噪比(SNR)的高斯白噪声,图9给出了煤岩图像加入不同信噪比的噪声的示意。

图9 不同信噪比下的待测样本图像

Fig.9 Test sample image at different SNR

在字典原子数为134,稀疏度为7的情况下,表4为测试样本中加入不同信噪比噪声后的煤岩识别率。

由表4可知,当图像中加入的高斯白噪声较少时,即信噪比高时,煤岩识别率略有下降,仍然满足实际需求,当噪声进一步增大时,识别率会大幅下降,无法满足实际要求。这就说明在应用煤岩识别技术之前,要对采集到的煤岩图像进行去噪处理。

表4 煤岩图像噪声对识别率的影响

Table 4 Influence of coal-rock image noise on recognition rate%

(1)局部约束的自学习煤岩识别方法,从未标记的非煤岩自然图像中获取图像的高层结构特征,结合局部约束线性编码提取煤岩图像特征,解决了由于样本太少导致获取的煤岩特征表达弱的问题,节省了获取标记煤岩图像样本耗费的人力物力;

(2)该方法采用局部约束线性编码的方式,相比于L1范数约束的编码方式具有更高的编码效率,得到的稀疏特征向量更加简洁,鉴别性更高,缩短了识别时间;

(3)该方法具有很强的鲁棒性,对于存在粉尘噪声干扰的煤岩图像仍具有很好的识别效果,能够用于井下采煤工作。

参考文献(References) :

[1] WANG Jinhua.Development and prospect on fully mechanized mining in Chinese coal mines[J].International Journal of Coal Science & Technology,2014,1(3):153-260.

[2] 孙继平,陈浜.基于CLBP和支持向量诱导字典学习的煤岩识别方法[J].煤炭学报,2017,42(12):3338-3348.

SUN Jiping,CHEN Bang.Coal-rock recognition approach based on CLBP and support vector guided dictionary learning[J].Journal of China Coal Society,2017,42(12):3338-3348.

[3] 佘杰.基于图像的煤岩识别方法研究[D].北京:中国矿业大学(北京),2014:11-23

SHE Jie.Study of coal rock recognition methods based on image processing[D].Beijing:China University of Mining & Technology(Beijing),2014:11-23.

[4] 伍云霞,田一民.基于最大池化稀疏编码的煤岩识别方法[J].工程科学学报,2017,39(7):981-987.

WU Yunxia,TIAN Yimin.A coal-rock recognition method based on max-pooling sparse coding[J].Chinese Journal of Engineering,2017,39(7):981-987.

[5] 伍云霞,张宏.基于Curvelet变换和压缩感知的煤岩识别方法[J].煤炭学报,2017,42(5):1331-1338.

WU Yunxia,ZHANG Hong.Recognition method of coal-rock images based on curvelet transform and compressed sensing[J].Journal of China Coal Society,2017,42(5):1331-1338.

[6] 孙继平,佘杰.基于小波的煤岩图像特征抽取与识别[J].煤炭学报,2013,38(10):1900-1904.

SUN Jiping,SHE Jie.Wavelet-based coal-rock image feature extraction and recognition[J].Journal of China Coal Society,2013,38(10):1900-1904.

[7] 孙继平,陈浜.基于小波域非对称广义高斯模型的煤岩识别算法[J].煤炭学报,2015,40(S2):568-575.

SUN Jiping,CHEN Bang.A coal-rock recognition algorithm using wavelet-domain asymmetric generalized Gaussian models[J].Journal of China Coal Society,2015,40(S2):568-575.

[8] 伍云霞,田一民.基于字典学习的煤岩图像特征提取与识别方法[J].煤炭学报,2016,41(12):3190-3196.

WU Yunxia,TIAN Yimin.Method of coal-rock image feature extraction and recognition based on dictionary learning[J].Journal of China Coal Society,2016,41(12):3190-3196.

[9] ZHU Xiaojin.Semi-supervised learning literature survey[M].University of Wisconsin-Madison,2006.

[10] 庄福振,罗平,何清,等.迁移学习研究进展[J].软件学报,2015,26(1):26-39.

ZHUANG Fuzhen,LUO Ping,SHI Zhongzhi,et al.Survey on transfer learning research[J].Journal of Software,2015,26(1):26-39

[11] RAINA Rajat,BATTLE Alexis,LEE Honglak.Self-taught learning:Transfer learning from unlabeled data[A].International Conference on Machine Learning[C].2007:759-766.

[12] 练秋生,石保顺,陈书贞.字典学习模型、算法及其应用研究进展[J].自动化学报,2015,41(2):240-260.

LIAN Qiusheng,SHI Baoshun,CHEN Shuzhen.Research advances on dictionary learning models,algorithms and applications[J].Acta Automatica Sinica,2015,41(2):240-260.

[13] BLITZER J,MCDONALD R,PEREIRA F.Domain adaptation with structural correspondence learning[A].Conference on Empirical Methods in Natural Language Processing[C].Association for Computational Linguistics,2006:120-128.

[14] DAI WY,XUE GR,YANG Q,et al.Co-Clustering based classification for out-of-domain documents[A].Proc.of the 13th ACM Int’l Conf.on Knowledge Discovery and Data Mining[C].New York:ACM Press,2007:210-219.

[15] DAI WY,YANG Q,XUE GR,et al.Self-taught clustering[A].Proc.of the 24th Int’l Conf.on MACHINE Learning[C].San Francisco:Morgan Kaufmann Publishers,2008:200-207.

[16] SHENG Li,KANG Li,YUN Fu.Self-taught low-rank coding for visual learning[J].IEEE Transactions on Neural Networks & Learning Systems,2018,29(3):645-656.

[17] RAZZAGHI Parvin.Self-taught support vector machine[J].Knowledge & Information Systems,2018:1-25.doi.org/10.1007/s10115-018-1218-6.

[18] WANG Jinjun,YANG Jianchao,YU Kai,et al.Locality-constrained linear coding for image classification[A].Proceedings/CVPR,IEEE Computer Society Conference on Computer Vision and Pattern Recognition[C].2010:3360-3367.

[19] WEI CP,CHAO Y W,YEH YR,et al.Locality-sensitive dictionary learning for sparse representation based classification[J].Pattern Recognition,2012,46(5):1277-1287.

[20] HSAIO W H,LIU C L,WU W L.Locality-constrained max-margin sparse coding[M].Pattern Recognition,2016.